Geçen hafta bir arkadaşım WhatsApp’tan yazdı: “Uygulama fikrim var ama kodlama bilmiyorum, ne yapayım?”

Claude’u anlattım. Üç saat sonra yine yazdı: “Tamam da… nereden başlayacağımı bilmiyorum.”

İşte o an fark ettim: Sorun artık bilmemek değil. Sorun başlamamak.

Bu yazı, tam olarak bu garip paradoks hakkında.

Bir Şeyler Değişti (ama çoğumuz fark etmedik)

William Gibson’ın o meşhur lafını bilirsiniz: “Gelecek zaten burada, sadece eşit dağılmadı.”

Gibson’ı da bu cümleyi de çok severim. Ama 2026’da bu cümlenin anlamı dramatik biçimde değişti. Eskiden “eşit dağılmadı” derken kastedilen şey kaynaklardı: Para, bağlantılar, eğitim, coğrafya. Zengin ülkede doğduysan gelecek sana daha yakındı.

Şimdi?

Şimdi aynı araçlara erişimi olan iki insan, aynı şehirde, aynı odada oturabilir—ve biri dünya değiştirirken diğeri Netflix izliyor olabilir.

Bu biraz acımasız bir gözlem, biliyorum. Ama acımasız olması yanlış olduğu anlamına gelmiyor.

Mazeret Fabrikası Kapandı

Bir düşünün: 2015’te bir yazılım projesi başlatmak için ne gerekiyordu?

2026’da aynı iş için ne gerekiyor?

Bu iki diyagram arasındaki fark, insanlık tarihinin en dramatik “bariyer çöküşlerinden” biri. Matbaanın bilgiyi demokratikleştirmesi gibi. Elektriğin enerjiyi demokratikleştirmesi gibi. Ama çok daha hızlı ve çok daha derinden.

Mustafa Süleyman’ın “The Coming Wave” kitabında anlattığı gibi, bu dalga sadece teknolojik değil—toplumsal, ekonomik ve psikolojik bir tsunami. Ve dalgayı görüp görmemeniz, o dalganın sizi yutup yutmayacağını değiştirmiyor.

Tabii “demokratikleşme” kelimesini her teknoloji devrimi için kullanıyoruz, sonra da yan etkileri görüp şaşırıyoruz. Ama bu sefer gerçekten farklı – en azından ölçek açısından. TıpkıSihirli Kutunun İçindeki Hayalet yazısında değindiğim gibi, elimizdeki araçların gücü ile onları anlama kapasitemiz arasındaki makas açılıyor.

Skill Issue → Will Issue

Eskiden bir fikrin hayata geçmemesinin bahanesi genellikle “beceri eksikliği”ydi:

“Film çekmek istiyorum ama kamera pahalı.” “Uygulama yapmak istiyorum ama kod bilmiyorum.” “Kitap yazmak istiyorum ama editör tutamam.”

Bu mazeret kategorisine Skill Issue (Beceri Sorunu) diyorduk. Ve haklıydı. Gerçekten de o beceriler yıllarca eğitim, binlerce saat pratik, ciddi sermaye gerektiriyordu.

Sonra ChatGPT oldu. Sonra Claude oldu. Sonra Midjourney, Suno, Cursor, Antigravity, v0 oldu.

Ve bir sabah uyandığımızda, o mazeretlerin çoğunun buhar gibi uçtuğunu fark ettik.

Şimdi mazeret şekil değiştirdi:

“AI var ama… öğrenmeye vaktim yok.” “Denedim ama… hata verdi, bıraktım.” “İlginç ama… bir gün bakarım.”

Bu yeni mazeret kategorisinin adı: Will Issue – İrade Sorunu.

Dikkat edin: Aynı kişi, aynı fırsatlar, aynı araçlar. Ama engel artık dışarıda değil, içeride. Görünmez Dostumuz: Yapay Zeka ile Yaşam yazısında sorduğum soruyu hatırlayın: “Kontrol kimde olmalı; bizde mi, algoritmalarda mı?” İşte bu soru artık farklı bir boyut kazandı: Kontrolü algoritmalar almadı, biz vermekten korkuyoruz.

High Agency Nedir? (Hapishane Metaforu)

George Mack, “High Agency” kavramını şöyle açıklıyor:

Düşük iradeli biri hapiste “kaderim bu” der, bekler.

Yüksek iradeli biri gardiyanların vardiyasını ezberler, tünel kazar, yine de kaçar.

Abartılı mı? Belki. Ama bir şeyi çok iyi yakalıyor: Aynı durum, iki farklı zihniyet tarafından tamamen farklı yorumlanabiliyor.

Biri engeli bir duvar olarak görüyor. Diğeri bulmaca olarak.

Stoikler buna “dichotomy of control” derdi: Kontrol edebildiklerini kontrol et, edemediklerini kabul et. Viktor Frankl ise“Man’s Search for Meaning”kitabında buna “insanın son özgürlüğü” derdi: Koşullar ne olursa olsun tepkini seçme özgürlüğün. Frankl, Nazi toplama kamplarında bile bu özgürlüğü koruyanların hayatta kaldığını gözlemledi. Kavram yeni değil yani. Ama yapay zeka bağlamında tamamen yeni bir anlam kazandı.

AI Çarpan Teorisi

Yapay zekanın etkisini anlamanın bir yolu: Çarpan.

Çoğu insan AI’ı bir eklenti gibi düşünüyor. “Bilgisayarım var, artık AI’ım da var, toplam gücüm arttı.”

Maalesef yanlış.

AI bir toplayıcı değil, çarpan:

Bu formülün acımasız tarafı ise: Sonsuz çarpı sıfır, sıfırdır.

En güçlü AI modeli, en iyi bilgisayar, en hızlı internet … Hiçbiri sizi bir adım bile ileri götürmez, eğer siz o adımı atmaya karar vermezseniz.

İki Paralel Evren

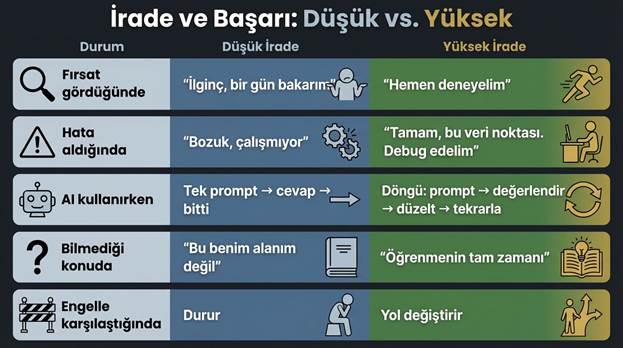

Aynı araçlara sahip iki insan düşünün. Biri düşük iradeyle, diğeri yüksek iradeyle yaklaşıyor. Nasıl farklı sonuçlar üretiyorlar?

Bu tablo biraz karikatürize, kabul ediyorum. Gerçek hayat bu kadar siyah-beyaz değil. Ama karikatürler bazen gerçeği daha net gösterir.

Bu tablodaki en kritik satır “hata aldığında” satırı.

Çünkü AI ile çalışmanın gerçeği şu: Çok hata alacaksınız. İlk prompt mükemmel sonuç vermeyecek. Kod hata verecek. Çıktı beklediğiniz gibi olmayacak.

Düşük iradeli kişi bunu “AI işe yaramıyor” olarak yorumluyor.

Yüksek iradeli kişi bunu “henüz doğru soruyu sormadım” olarak yorumluyor.

Kod, Et ve Hizalanma Sorunu yazısında Frankenstein’ın Yaratığı’nın “reward hacking” yapmasını analiz etmiştim—yani yanlış bir hedef fonksiyonuna doğru optimize olmasını. İnsanlar da aynısını yapıyor: “Rahatlık” hedefine optimize oluyoruz ve bu bizi “anlamlı çıktı” hedefinden uzaklaştırıyor.

“Just-in-Time” Öğrenme: Eğitimin Yeni Doğası

Geleneksel eğitim modeli “Just-in-Case” mantığıyla çalışıyordu: “Ne olur ne olmaz, belki bir gün lazım olur” diye dört yıl üniversite oku, üç yıl staj yap, sonra belki o bilgiyi kullan.

Bu modelin arkasındaki varsayım şuydu: Bilgi kıt ve pahalı. Erişim zor. O yüzden “stokla” ileride lazım olursa hazırsın.

AI çağında bu varsayım çöktü.

Şimdi öğrenme “Just-in-Time“: Tam olarak ihtiyacın olduğu anda, tam olarak ihtiyacın olan bilgiyi al ve uygula.

Hata yaptın mı? AI debug ettiriyor. Takıldın mı? AI alternatif yollar gösteriyor. Anlamadın mı? AI beş farklı şekilde açıklıyor.

Bu, “eğitimli olmak”ın ne demek olduğunu temelden değiştiriyor. Artık önemli olan ne bildiğin değil, ne kadar hızlı öğrenebildiğin. Ve belki daha da önemlisi: Öğrenmeye ne kadar istekli olduğun.

Ajanlar ve Döngüsel Düşünme

2024’ün en büyük AI gelişmesi, çoğu kişinin fark etmediği bir şeydi: Modellerin “tek soru-tek cevap” mantığından çıkıp ajan mantığına geçişi.

Eskiden AI’ya “bunu yap” diyordunuz, o yapıyordu (ya da yapamıyordu), biterdi.

Şimdi AI’ya “bu hedefe ulaşana kadar kendini düzelt” diyebiliyorsunuz.

Bu fark, ilk bakışta küçük görünüyor. Ama devasa.

Çünkü artık AI sizin yerinize iterasyon yapabiliyor. Hata alıyor, analiz ediyor, düzeltiyor, tekrar deniyor. Siz uyurken bile.

High Agency sahibi insanlar bu değişimi hemen kavradı. Düşük iradeli insanlar hâlâ “prompt atıyorum, garip cevap veriyor” modunda takılı kaldı.

Founder Mode: Detaylara Hakim, Yapıcı Kal

Paul Graham’ın 2024’te Y Combinator’da ortaya attığı “Founder Mode” kavramı, AI çağının liderlik modelini özetliyor:

Geleneksel yönetim doktrini diyordu ki: “Delege et, karışma. Mikro-yönetim kötü.”

Founder Mode diyor ki: “Detaylara hakim ol, yapıcı kal.”

Bu iki yaklaşım eskiden çelişkili görünüyordu. Hem detaylara hakim olup hem de ölçeklenebilir olmak imkansızdı. Günde sadece 24 saat var, her şeye yetişemezsin.

AI bu denklemi kırdı.

Artık bir lider, eskiden 10 kişilik ekibin yapacağı işi AI asistanlarıyla tek başına yapabilir. Bu şu anlama geliyor:

Editör Zihniyeti: AI üretir, siz seçer ve rafine edersiniz. “Taste” ve “curation” her zamankinden daha değerli.

Standart Mühendisliği: Önemli olan “prompt mühendisliği” değil, neyin kabul edilebilir olduğuna dair standartları belirlemek ve AI’ı o standartlara zorla ulaştırmak.

Mikro-Makro Akışkanlığı: Aynı gün içinde stratejik vizyon belirleme ve bir kod satırını debug etme arasında akıcı geçiş.

Bu üçüncü madde özellikle önemli. Geleneksel yönetim “ya strateji ya operasyon” diye düşünüyordu. AI çağında bu ayrım bulanıklaşıyor. Graham’ın Airbnb CEO’su Brian Chesky’den aktardığı gibi: Standart yönetim tavsiyelerini dinleyenler genellikle hayal kırıklığına uğruyor.

Pratik: Yüksek Eylemlilik Nasıl Yapılır?

Teori güzel ama pratiğe dökülmezse anlamsız. İşte somut adımlar:

1. “Bilmiyorum”u Sözlüğünüzden Silin

“Bilmiyorum” artık geçerli bir mazeret değil. Her şey ya öğrenilebilir ya da AI’a yaptırılabilir.

Yeni soru şu: “Bunu öğrenmek için ne kadar istekliyim?”

Bu soru daha dürüst. Çünkü “bilmiyorum” genellikle “öğrenmek istemiyorum”un maskesi.

2. Tüketici Değil Üretici Olun

AI’ı nasıl kullandığınız, agency düzeyinizin en net göstergesi.

Tüketim modunda AI: Eğlence, ödev yaptırma, dedikodu, “şunu sor şunu de” oyunları.

Üretim modunda AI: İş akışları kurma, sistemler inşa etme, değer üreten yapılar oluşturma.

Her AI etkileşiminde kendinize sorun: “Bu tüketim mi, üretim mi?”

TıpkıMetal Tanrılardan Dijital Aşıklara yazısında bahsettiğim Her filmindeki Theodore gibi: Samantha ile ilişkisi tüketim miydi, üretim mi? Film bu soruyu açık bırakıyor—ama bizim bırakmamamız gerekiyor.

3. Döngüler Kurun, Tek Atış Yapmayın

Tek prompt atıp cevabı kabul etmek, AI’ın potansiyelinin yüzde birini kullanmak demek.

Bunun yerine:

Bu döngüsel yaklaşım, sonuçları katlanarak iyileştirir.

4. Hata = Veri

Hata aldığınızda durmayın. O hata mesajı, çözüme giden yolda kritik bir veri noktası.

AI’a hatayı gösterin. Debug edin. Alternatif yaklaşımlar deneyin.

High Agency kişiler için “olmadı” kelimesi mevcut değildir. Sadece “henüz olmadı” vardır.

Sinemadan Bir Ders: Kontrol Yanılsaması

Yine Metal Tanrılardan Dijital Aşıklara yazısından dikkat çekici bir şey var: Korku her zaman “kontrol kaybı”yla ilgili.

Terminator’de kontrol kaybı fiziksel: Makineler bizi öldürecek.

Her’de kontrol kaybı duygusal: Makineler bizi terk edecek.

Ex Machina’da kontrol kaybı entelektüel: Makineler bizi kandıracak.

Ama belki de asıl korkmamız gereken şey bu değil. Belki asıl korkmamız gereken, kontrolü kendimiz teslim etmek. Mazeretlerimizle, ertelemelerimizle, “bir gün”lerimizle.

Rahatsız Edici Bir Gerçek

Bu yazının şimdiye kadar söylediklerini şöyle özetleyebiliriz:

Araçlar eşitlendi. Fark artık içeride.

Bu, özgürleştirici bir mesaj olabilir. “Herkes yapabilir!” Demokratikleşme! Fırsat eşitliği!

Ama aynı zamanda rahatsız edici bir mesaj. Çünkü şunu da söylüyor:

Artık başarısızlığın sorumluluğunu dışarıya atamayız.

Eskiden “param yoktu”, “bağlantılarım yoktu”, “eğitimim yoktu” diyebildik. Bu mazeretlerin çoğu gerçekti. Gerçekten de yapısal engeller vardı.

Şimdi o engellerin büyük kısmı kalktı. Ve bu, bazılarımız için rahatsız edici. Çünkü mazeret kalkanı olmadan, geriye sadece kendi tercihlerimiz kalıyor.

Bu herkes için geçerli değil, tabii. Hâlâ ciddi yapısal eşitsizlikler var, özellikle Türkiye’de. İnternet erişimi, temel eğitim, güvenli yaşam koşulları. Ama bu koşulların sağlandığı yerlerde, bariyer büyük ölçüde psikolojik.

Sonuç: Tercih Sizin

Yapay zeka devriminin en derin gerçeği şu: Bu teknoloji tarafsız bir güç çarpanı.

Tembeli daha tembel yapar—çünkü artık daha az çabayla aynı yerde kalabilir.

Hırslıyı daha güçlü yapar—çünkü her adımı on katına çıkarabilir.

Mazeretçiyi daha mazeretçi yapar—çünkü yeni teknolojileri yeni mazeret malzemesine dönüştürebilir.

Eylemciyi daha etkili yapar—çünkü elindeki kaldıraç tarihte görülmemiş boyutlarda.

“Skill Issue” devri kapanıyor. “Will Issue” devri açılıyor.

Artık soru “Yapabilir misin?” değil.

Soru “Yapacak mısın?”

Tarihin bu garip anında, herkesin önünde aynı araçlar duruyor. Fark, o araçları kimin bugün alıp kullanacağında. Kimin de “bir gün” deyip erteleyeceğinde.

High Agency bir yetenek değil. Bir tercih.

Ve o tercihi yapmak için tek ihtiyacınız olan şey, bugün, şu an, bir adım atmak.

Hangi adım olduğu bile o kadar önemli değil.

Önemli olan adımı atmak.

Derinleşmek İsteyenler İçin

- George Mack — High Agency — Kavramın kapsamlı açıklaması

- Paul Graham — Founder Mode — AI çağında liderlik üzerine

- Viktor Frankl — Man’s Search for Meaning — İradenin felsefi temelleri

- Mustafa Suleyman — The Coming Wave — AI dalgasının toplumsal etkileri